近日,中国科学院空天信息创新研究院(空天院)王超研究团队在合成孔径雷达(SAR)遥感视觉语言模型领域取得新进展,实现了高分辨率SAR图像的精准视觉定位。

SAR图像视觉定位(SARVG)也称为“指称表达理解”,主要涉及两种输入模态:计算机视觉和自然语言。它旨在预测图像中语言表达所指示的目标的位置。视觉语言模型能够将文本、SAR遥感图像等不同模态信息进行深度融合,提高SAR数据在复杂环境下的应用效率和辅助决策制定。

然而,现有方法在建立模态内的全面理解和模态间的准确对应关系的仍有不足,尤其对于SAR的侧视几何特征而言,有效地学习语言引导的视觉信息仍然是SARVG的重大挑战。

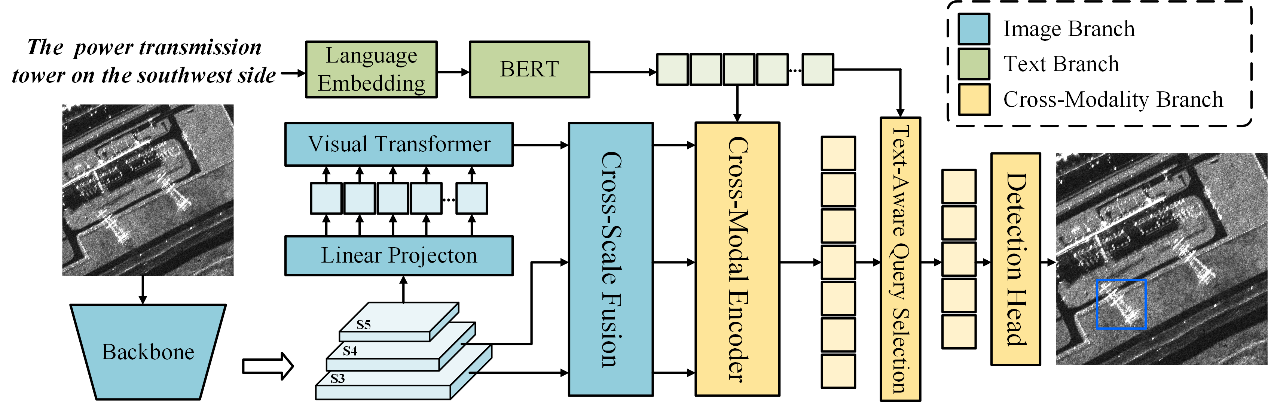

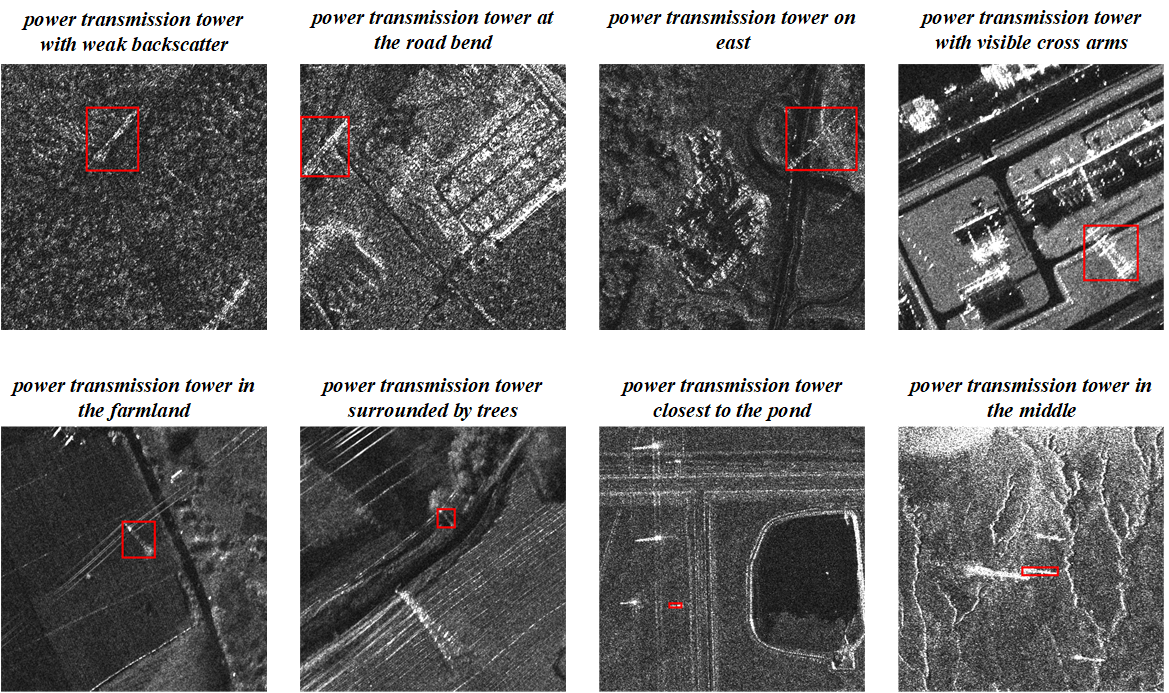

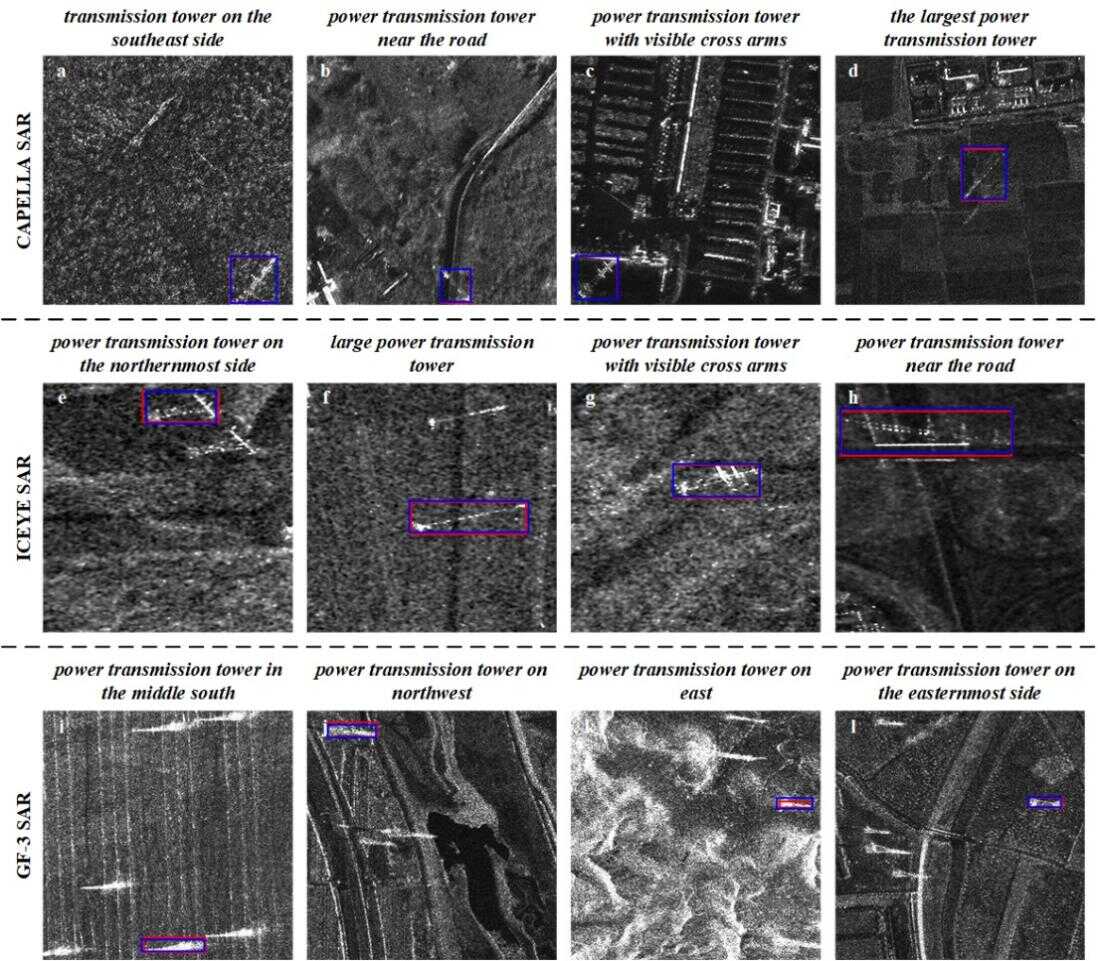

为了应对上述问题,研究团队利用CAPELLA、GF-3和ICEYE三种高分辨SAR数据,构建了一个基准数据集SARVG1.0,并在此基础上提出一种基于文本感知跨模态Transformer的SAR图像视觉定位新方法(TACMT)。通过设计跨模态编码器、文本感知查询选择模块和高效多尺度融合方法,解决SAR图像背景复杂性和模态信息对齐问题,实现高精度的目标视觉定位。

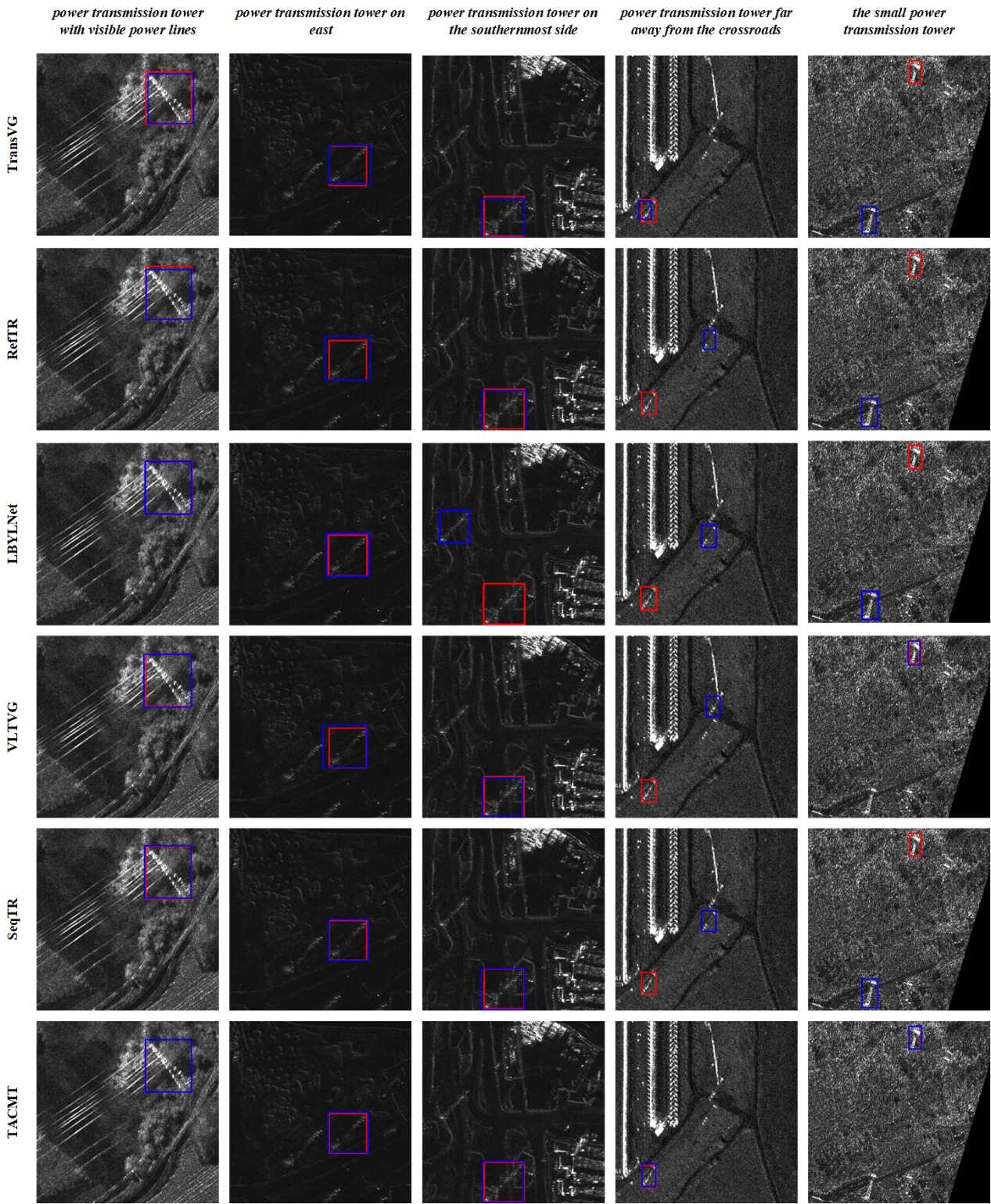

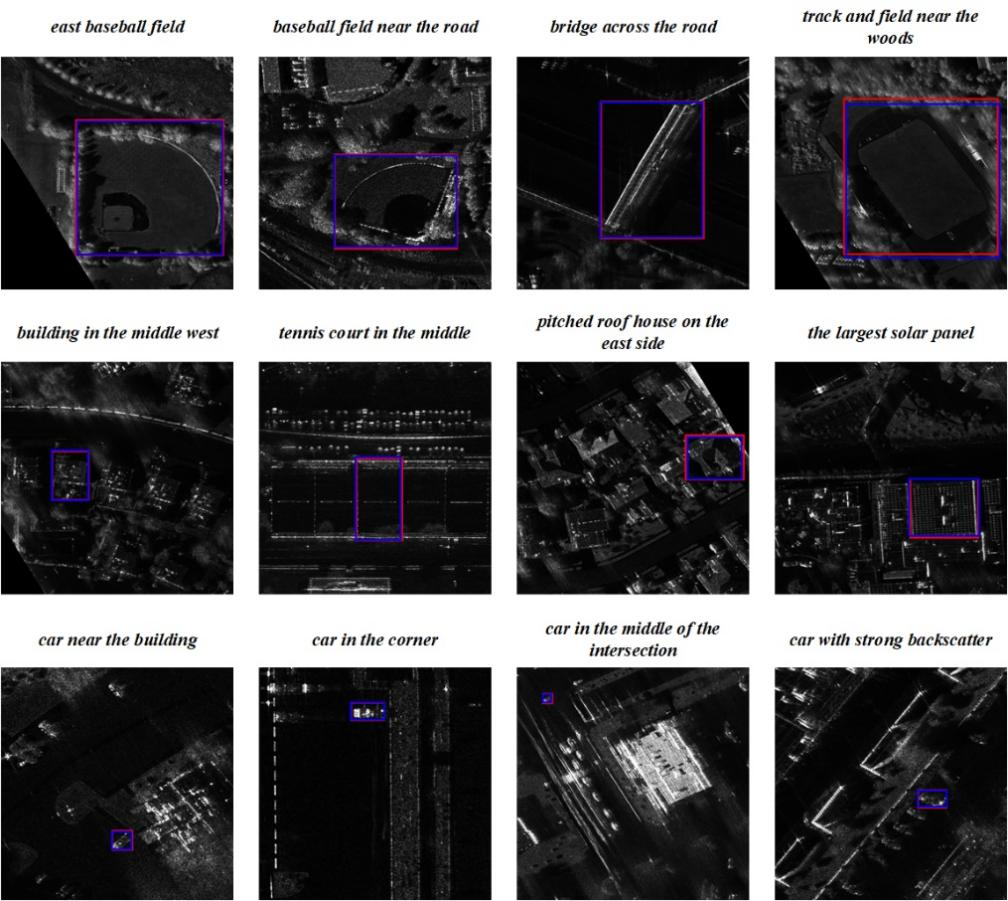

研究团队在SARVG1.0和FARAD SAR数据集基础上,进行实验评估,实现了对高压输电塔、运动场、桥梁、房屋、车辆等目标的实例级检测。评估结果表明,TACMT在mIoU指标上达到82.81%,Pr@0.5达到89.38%,在多类目标上的迁移学习上mIoU指标优于76%。

此项研究旨在为SAR领域视觉语言模型方向提供可行的解决方案,为提升人工智能对SAR图像与自然语言多模态内容的理解和认知效率,降低SAR数据的专业壁垒提供见解。

上述研究成果以“TACMT: Text-aware cross-modal transformer for visual grounding on high-resolution SAR images”为题,发表在遥感领域权威期刊《ISPRS Journal of Photogrammetry and Remote Sensing》(中国科学院一区TOP,IF=10.6)。空天院博士研究生李天阳为第一作者,研究员王超为通讯作者。研究工作由国家自然科学基金委员会重大科学仪器研制项目(42327801)和重点基金项目(41930110)资助。

论文链接:https://www.sciencedirect.com/science/article/pii/S0924271625000802

图1 研究团队提出的文本感知跨模态Transformer模型架构

图2 SARVG1.0数据集样本示例

图3 与其他方法的对比

图4 不同传感器的泛化结果

图5 其他目标的检测结果

动态新闻